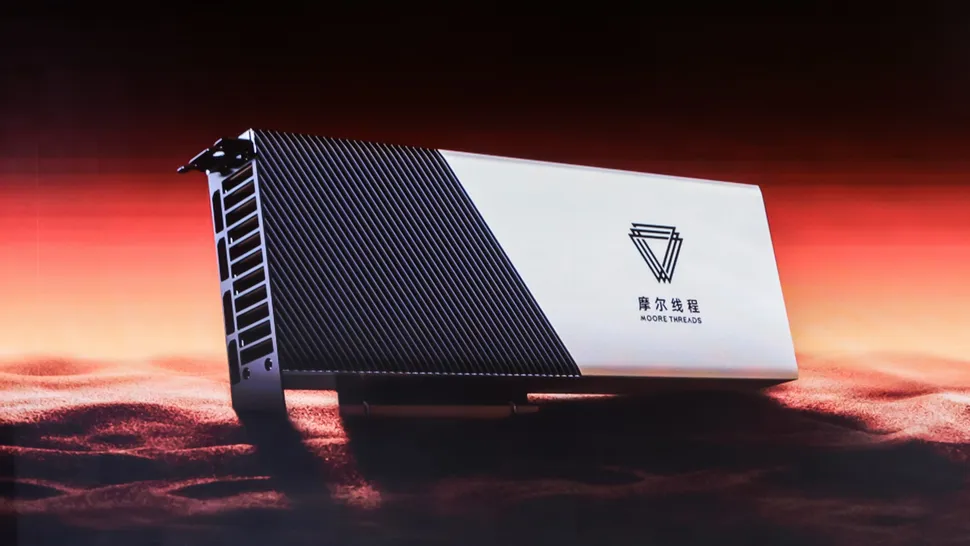

Moore Threads afirma que el nuevo acelerador de GPU del modelo S4000 AI ha hecho un gran progreso en términos de velocidad en comparación con el modelo anterior. En las noticias realizadas por CNBETA, el régimen de capacitación del clúster de procesamiento de información inteligente de Qianka a un nuevo KUA que respalda las GPU S4000 fue el tercero más rápido en las pruebas de IA, que funcionó mejor que muchas contrapartes de los grupos de GPU Nvidia AI.

El estudio de comparación se tomó de la prueba de estabilidad del proceso de información inteligente de Qianka establecido en KUA. El entrenamiento duró un total de 13.2 días y se realizó perfectamente sin ninguna falla o interrupción durante la carrera. El modelo de inteligencia artificial utilizado para comparar el nuevo conjunto de información fue el modelo de lenguaje grande MT-Infini-3B.

Se informa que el nuevo conjunto de computadora se encuentra entre los mejores grupos de GPU de IA en la misma escala (probablemente el mismo número de GPU). Sin embargo, la tabla anterior es absolutamente falta de detalles. MTT S4000 SET, por ejemplo, en comparación con las GPU NVIDIA no especificadas; No sabemos si hay GPU A100, H100 o H200, pero probablemente sospechamos que es la A100. Las cargas de trabajo no son las mismas. Por ejemplo, educar a MT-SiFlex-3B puede ser bastante diferente de educar a Llama3-3b.

Incluso si no como se afirma, la capacitación de las chips de inteligencia artificial en las GPU de Moore Threads representa un paso importante en la hoja de ruta nacional de GPU de China. El proceso de información de Qianka establecido en KUA muestra que al menos las GPU MTT S4000 AI son competitivas con la arquitectura A100 de generación anterior de NVIDIA. Esto no solo funciona significativamente mejor que los predecesores de GPU S3000 y S2000 AI del hilo S4000 del S4000, sino también con figuras de rendimiento en bruto que funcionan mejor que los aceleradores de IA basados en Turing de NVIDIA. El S4000 no coincide con los aceleradores de GPU AI de A100 de NVIDIA, pero quizás no lejos de los niveles de rendimiento de los amperios.

Para los hilos de Moore, la capacidad de rendimiento de Qianka para KUA es una gran ganancia, sin importar qué GPU de NVIDIA o LLM se prueben. Esto muestra que Moore Threads ahora tiene la capacidad de crear GPU AI que puedan hacer tareas similares con los competidores de AI GPU de NVIDIA, AMD e Intel. Puede que no funcione mejor, pero es un paso importante en el camino hacia las superptuts de súper más rápidas y talentosas y los grupos de inteligencia artificial.

Este es un éxito impresionante para un fabricante de GPU, que se fundó hace menos de cinco años. Si los hilos de Moore pueden continuar proporcionando una generación significativa de mejoras en el rendimiento, puede tener un acelerador de AI GPU que puede competir con los competidores occidentales en los próximos años.

Fuente: https: //www.tomshardware.com